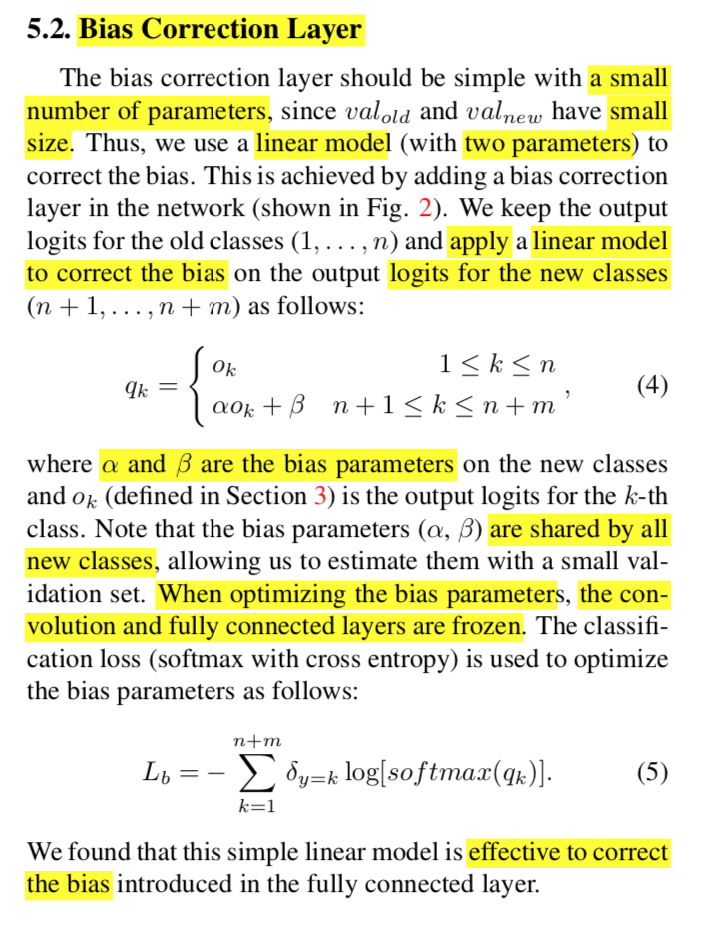

就简单的说明一下好了,首先是使用蒸馏学习,然后再利用验证集来学习一个简单的线性变换 ax + b 来减少偏差。

这里是把验证集也拿过来训练了,虽然只是学习一个简单的线性变换,因为这个线性变换只有两个参数,所以需要的数据量非常少,虽然这个变换很简单,但是非常有效的提高精度。

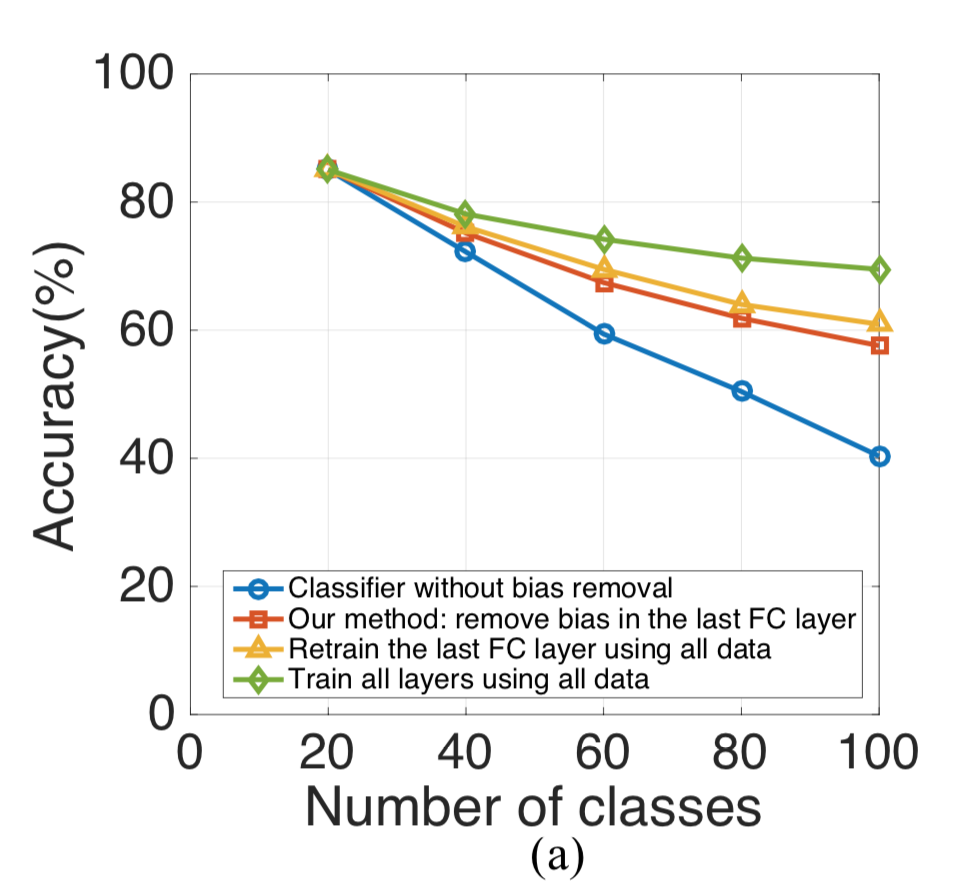

文章中说的偏差指的是增量学习的精度和全部数据一起训练的精度的差距。

1 什么是偏差

偏差就是增量学习的精度和用全部数据训练的精度的差。

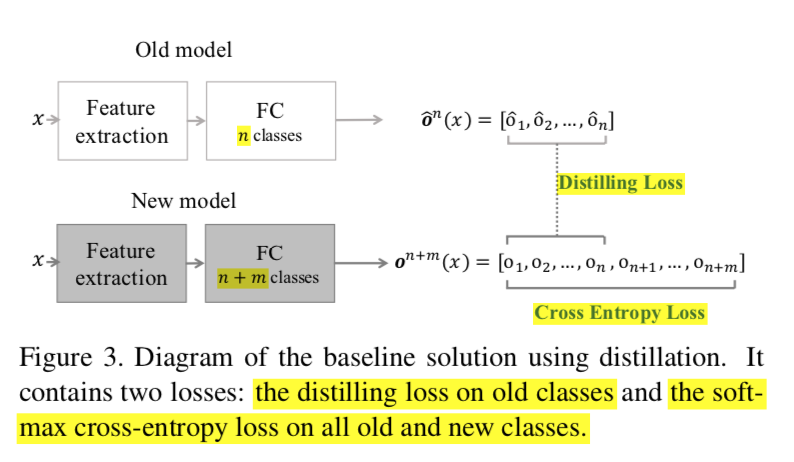

2 网络

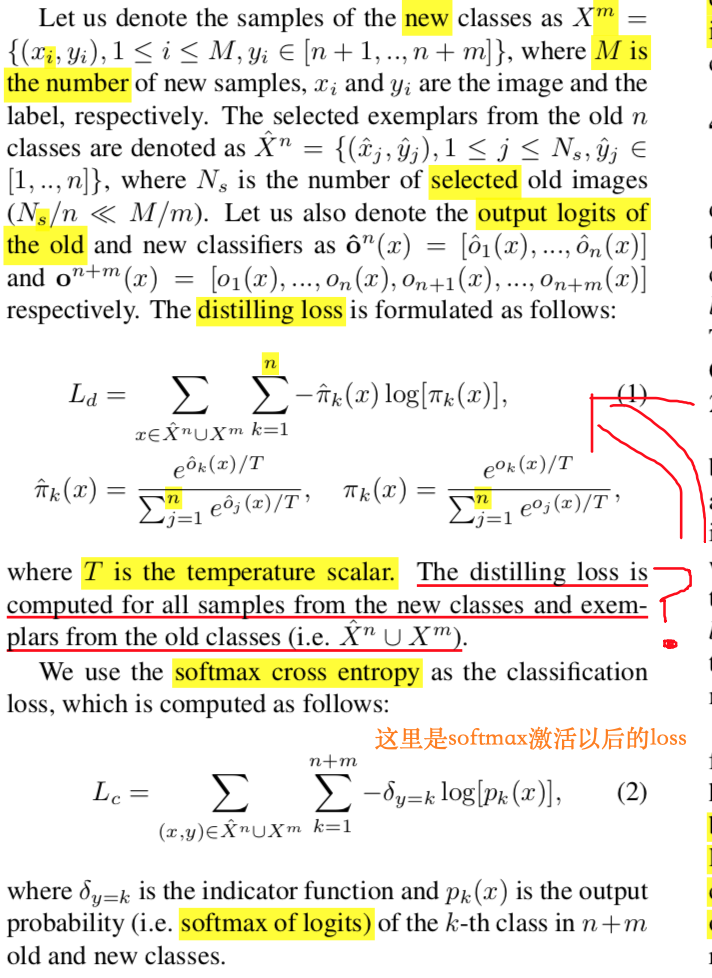

这里蒸馏学习的一个loss是logit之间的loss(即没有softmax激活的)。

结合蒸馏学习和普通分类loss来进行学习。

3 loss

蒸馏学习的时候,新数据和老数据的蒸馏loss都是要计算的,无论是新的类别还是老的类别,这里其实是计算一个特征提取器的loss,让新的特征提取器提取的特征和老的一样。

4 偏差矫正层